El desarrollo de modelos de inteligencia artificial requiere conjuntos de datos representativos y de alta calidad. Estos datos deben satisfacer los requisitos y reflejar el entorno con el que se enfrentará el modelo durante su uso. Dado que los modelos aprenden patrones y relaciones directamente a partir de los datos, su selección constituye un paso muy importante para garantizar el correcto desempeño en las tareas para las que han sido diseñados.

En Capsul-IA se han seleccionado conjuntos de datos públicos para atender los requisitos de cada una de las cápsulas del proyecto. La cápsula de visión emplea datos para tareas de detección y clasificación de imágenes, así como aplicaciones de robótica; la de texto utiliza un corpus documental multilingüe; y la de optimización incorpora información estructurada del ámbito marítimo.

En primer lugar, para la tarea de detección de objetos se ha escogido el conjunto de datos CrowdHuman. Este, tal y como lo definen sus autores, es un conjunto que permite la detección de personas en multitudes, destacando precisamente en esto, la densidad de personas por imagen. Cuenta en su totalidad con unas 20.000 imágenes y unas 470.000 instancias de personas, lo que se traduce en unas 23 personas por imagen. En comparación con otros conjuntos de datos de referencia usados para esta misma tarea, se tiene una densidad seis veces mayor, lo que permitirá al modelo mejorar su rendimiento en escenarios complejos.

En la tarea de clasificación de imágenes, se ha seleccionado EuroSat, orientado a una tarea de clasificación de terreno a partir de imágenes satelitales. El conjunto ofrece tanto imágenes en formato RGB como multiespectrales, distribuidas en 10 clases y con un total de unas 27.000 muestras.

Para las aplicaciones de robótica, se emplean datos generados en sistemas basados en ROS (Robot Operating System), que permiten registrar de forma estructurada información procedente de cámaras y sensores. ROS utiliza formatos específicos para almacenar estos datos, por lo que es necesario convertir las imágenes a formatos estándar como PNG o JPG antes de emplearlas en los modelos de visión. Este conjunto de datos lo proporciona directamente PAL desde sus robots.

Continuando con la cápsula de texto, se han recogido documentos de distintas fuentes. En concreto se trata de documentos extraídos de los portales web del Poder Judicial Español y EUR-Lex, además de licitaciones de contratación pública. El conjunto total comprende alrededor de 32.000 documentos en 24 idiomas distintos, con un mínimo de 1.000 documentos por idioma, siendo el español el idioma predominante al concentrar el mayor número de documentos.

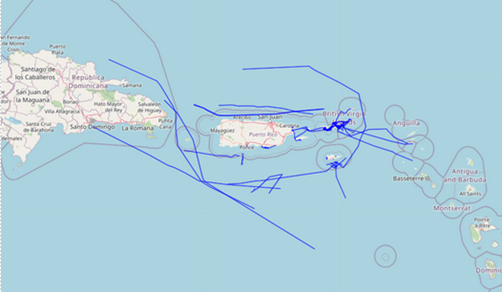

Por último, el optimizador multicriterio tomará los datos del Sistema de Identificación Automática o AIS, que almacena información sobre embarcaciones, como puede ser su posición para que otras embarcaciones conozcan la misma y se puedan evitar colisiones. Se dispone de registros para todos los días del año 2024, lo que genera un fichero diario de casi 1 GB de información.

Gracias a estos conjuntos de datos, Capsul-IA consolida una base sólida para el desarrollo de modelos de inteligencia artificial más precisos, fiables y adaptados a los desafíos específicos de cada cápsula del proyecto.

El código inicial de la cápsula de visión ya está disponible en este repositorio. Este repositorio se irá actualizando y recibiendo mejoras conforme avance el proyecto.

Andrés Pacheco – Informático especializado en IA

Agradecimientos

Proyecto MIG-20232044, subvencionado por el CDTI – Centro de Desarrollo Tecnológico Industrial, apoyado por el Ministerio de Ciencia e Innovación, y aprobado en la convocatoria para el año 2023 del procedimiento de concesión de ayudas destinadas a “Misiones de Ciencia e Innovación” en el marco de la iniciativa TransMisiones 2023, en el ámbito del Programa Estatal para Catalizar la Innovación y el Liderazgo Empresarial del Plan Estatal de Investigación Científica y Técnica y de Innovación 2021-2023.

Proyecto PLEC2023-010240 financiado por MICIU/AEI/10.13039/501100011033: